查看更多

密码过期或已经不安全,请修改密码

修改密码

壹生身份认证协议书

同意

拒绝

同意

拒绝

同意

不同意并跳过

黏膜损伤的内镜下表现是溃疡性结肠炎(UC)病情严重程度评估的重要组成部分。虽然现有生物标志物如粪便钙卫蛋白和组织病理学可用于黏膜损伤评估,但内镜检查在反映疾病严重程度和治疗反应中,仍是一项重要客观检查,对于UC诊断及治疗决策有重要意义。因此,在最近出版的ACG临床管理指南、STERID国际共识声明及临床试验中,常规内镜检查都被推荐用于评估疾病状态。目前有多种内镜评分体系用于UC严重程度分级,其中Mayo内镜评分(MES)由于其易用性成为临床中最常用的分级系统。MES根据红斑、糜烂、溃疡和出血等特征疾病严重程度分为4个等级级(得分0-3),分数越高反映疾病严重程度更重。除了评估治疗效果外,MES评分还可用于预测预后,MES评分与未来结肠切除术和临床复发的风险相关。然而图像评估主观性降低了MES评分的准确性和可重复性。人工智能(AI)提供了一种解决人类在图像评价中固有主观性的方法,在以前的研究中,研究者已经将深度学习技术用于静态内镜图像MES评分,然而,相较于静态内镜图像,在结肠镜视频中完成MES判读需要消除食物残渣、粪便、低图像质量以及介入性组织损伤等混杂因素的干扰,虽然这对于经验丰富的胃肠病学家是容易完成的任务,但目前AI无法消除这些混杂因素的影响。

研究者提出了新型人工智能判读流程用于分析全动态视频,借助于区分视频信息部分和非信息部分的方法,自动生成UC患者的Mayo内镜评分。

美国一项初期研究表明,使用新型人工智能系统为UC患者进行内镜评分,可达到与专家判读相近的准确性。文章发表于《消化内镜》[Gastrointest Endosc 93(1):728]杂志3月刊。

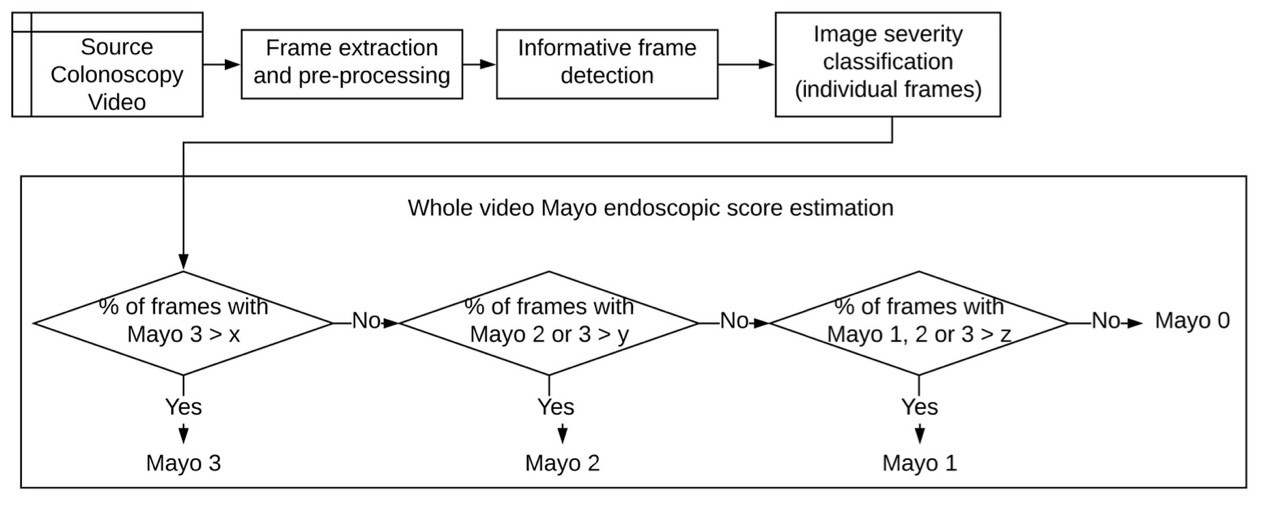

本研究中使用了创新性AI识别方法,内镜视频首先被分割成每秒1帧的静止图像栈,内镜图像经过预处理、自动裁剪和填充成标准正方形,以保持图像的一致性,而不扭曲图像比例,并将分辨率调整至256×256,以便输入到卷积神经网络。为防止过度拟合,图像经过旋转、缩放、剪切以及垂直和水平方向的随机变换,以提高数据集的可变性。信息帧随后被传递给MES静态图像分类器进行MES评分,MES静态图像分类器使用约3000名UC受试者的16000张静态图像的数据集完成建模,由2名具有临床试验经验的专家对图像评分进行标记,分数分歧由第三位评审员裁决。分类器分析后对每段视频Mayo 0、1、2或3的信息帧百分比进行计算,基于各个类别图像比例推断出总体Mayo得分,选择满足视频中帧的阈值比例的最高Mayo分数作为总体Mayo分数。本研究使用本地高分辨视频数据集对单个分析模块进行培训和测试,并使用外部临床试验数据集验证AI识别效果。

图1 人工智能自动MES分级流程图 原视频转换成静止帧堆栈,通过裁剪和缩放以实现图像的均匀性。经过预处理后,图像被传递给分类器,以区分“有效信息”与“无效信息”,使用分类器对信息图像进行疾病严重程度分级。最后,利用视频中所有图像的疾病严重程度预测等级的相对比例来获得整个视频Mayo内镜评分。

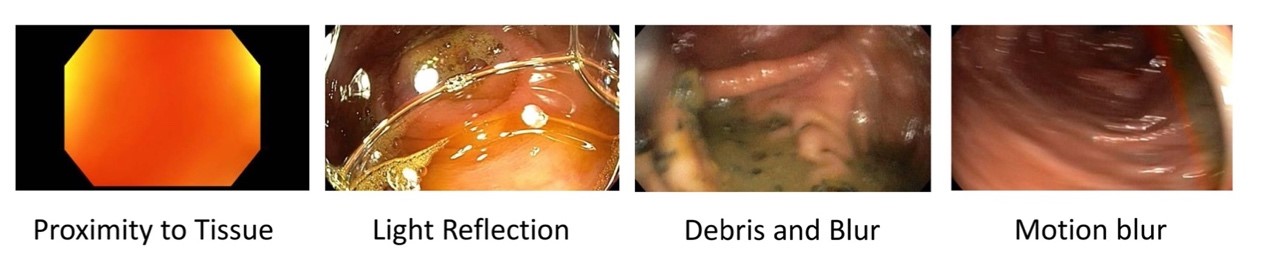

首先是AI培训和测试,在51段本地高分辨视频中共提取34810帧静止图像栈,将内镜图像质量作为基本分类依据将其分类为“有效信息”与“无效信息”, “无效信息”由以下特征定义的,包括(1)相机离黏膜过近;(2)肠道准备不足导致黏膜模糊;(3)相机运动导致模糊;(4)光强过度或过弱。根据5倍交叉验证卷积神经网络在区分“有效信息”与“无效信息”图像方面表现优异,平均AUC为0.961,准确度、灵敏度和特异度分别为0.876、0.902和0.870。学习曲线评估表明本地高分辨率视频数据集训练样本的数量是足够的,增加更多的训练样本可能对人工智能系统仅有有限的改善。在MES评分方面,自动化MES系统显示出很好的一致性,并在78%(40/51)的视频中正确预测了MES,与专家评分的差异集中在轻度疾病分级。

图2 内镜视频无效信息示例 内镜原视频由大量不适合疾病严重程度分级的图像组成,影响疾病严重程度自动分级的常见混杂因素包括图中所示的混杂因素以及曝光过多和曝光不足,区分内镜视频中“有效信息”与“无效信息”以确定适合评估的视频部分。

创建稳定系统后使用264段外部临床试验数据对人工智能识别质量进行验证,外部临床试验数据集因为视频来自不同的来源和不同的录制条件,与高分辨率数据集相比更具挑战性。区分“有效信息”与“无效信息”图像方面,其平均AUC为0.930,准确度、灵敏度和特异度分别为0.844、0.834和0.851,与高分辨视频测试结果相似,人工智能系统在83.7%(221/264)的视频中正确区分了Mayo 0-1和Mayo 2-3内镜严重程度,与内镜中心评价者评分准确性相似。

医生从静态图像中获取信息以准确判断疾病存在与否及严重程度相对容易,但对消化内镜检查等动态视频判读仍有一定困难,需要统一培训及反复训练以提高判读准确性,目前越来越多的神经网络分类方法被应用于放射学、组织学、内镜检查中。人工智能在识别动态图像中存在天然不足即缺乏对整体的把握,在内镜图像评估时整体意识至关重要,这对于医生而言是一个直观的基本原则,但是对人工智能则是巨大的挑战,一个20分钟的视频包含360000单独的图像,其中约60%的图像是无意义的,因此,区分信息质量对提升人工智能识别至关重要。本研究介绍了应用深度学习技术实现UC自动化分级,为提高系统捕捉有效信息能力,对原始信息进行分类即“有效信息”和“无效信息”,通过对图像进行区分,极大提高了人工智能分析系统的性能。在初步测试中,虽然人工智能在MES准确评分方面仍需进一步完善,但在Mayo0-1分/2-3分的分类中表现优异,为内镜随访及临床试验注册提供重要参考依据。未来该系统仍需进一步完善图像分类,以除外影响评分质量的混杂因素,包括活检相关出血、视频记录质量、图像压缩产生的伪影。

本研究存在一定缺陷,其中之一是构造模型队列及验证队列患者疾病严重程度分布差异,未来的开发和验证可在均匀分布的疾病严重程度数据集中进行;其次,结肠镜图像采集的人为差异仍无法避免,这可以通过同一受试者重复结肠镜检查及评分进行排除。

尽管现有方法仍不成熟,但这一结果为人工智能IBD内镜严重程度分析开发及应用提供重要依据。疾病活动评分神经网络模型因其可在普通桌面计算机上运行而具有普遍可及性,与内镜视频审查中心相比AI系统成本更低,为医学研究、临床实践提供更加经济、有效的手段的同时保证内镜图像评估一致性。同时本研究认为改善AI内镜分析性能,需克服内源性和介入性组织损伤所产生的判读偏倚等关键障碍,以提高AI对疾病的认知水平。新出现的评分系统,如溃疡性结肠炎内镜活动指数(UCEIS)可能比MES在AI判读中更有优势,尽管UCEIS 的单个指标(如溃疡、出血)的分级比MES复杂,但UCEIS可减少MES严重程度等级之间的模糊性,从而提高AI评分准确性。此外,组织学在UC严重性评估中的日渐重要,目前正在探索深度学习方法,以根据内镜下表现直接推断组织学评分。消化系病学中的机器学习方法尚处于起步阶段,但随着技术进步正在迅速成熟,AI已经实现对于静态数据的专家级判读,随着技术的进步及完善AI将在内镜动态视频判读方面崭露头角。

本文由首都医科大学附属北京友谊医院消化内科黄鑫源整理,张澍田教授审阅

(本文版权属于《中国医学论坛报》,转载请注明出处)

查看更多